드디어 가능해진 라데온 GPU AI 연산

최근 AMD에서 ROCm 7.2를 발표하면서 Windows 지원이 공식적으로 시작되었다.

그동안 PyTorch GPU 연산은 대부분 NVIDIA CUDA 환경에서 사용되어 왔지만, 이제 AMD GPU에서도 ROCm 기반 PyTorch를 사용할 수 있는 환경이 점점 현실화되고 있다.

ROCm(Radeon Open Compute)은 AMD에서 제공하는 GPU 컴퓨팅 플랫폼으로, NVIDIA의 CUDA와 비슷한 역할을 한다.

특히 흥미로운 점은 공식 지원 목록에는 없지만 동일한 아키텍처 계열인 RX 7600에서도 정상적으로 동작하는 것을 확인했다는 점이다.

그래서 이번 글에서는 Windows + AMD GPU 환경에서 PyTorch GPU 연산을 사용하는 방법을 단계별로 정리해보려고 한다.

시스템 요구사항

설치를 시작하기 전에 다음 사항을 확인하세요:

- 운영체제: Windows 10/11 (64-bit)

- GPU: AMD Radeon RX 7000 시리즈 (RDNA 3 아키텍처)

- 드라이버: 최신 AMD Adrenalin 드라이버 설치 권장

- Python: 3.12.x (필수 – 버전 호환성 중요)

- 디스크 공간: 최소 10GB 여유 공간

ROCm Windows 지원 GPU

ROCm 7.2 기준 Windows에서 공식적으로 지원되는 GPU는 다음과 같다.

| Architecture | GPU |

|---|---|

| gfx1201 | RX 9070 |

| gfx1200 | RX 9070 XT |

| gfx1100 | RX 7900 XTX |

| gfx1101 | RX 7700 |

| – | Radeon PRO W7900 |

공식 문서: AMD ROCm Windows Compatibility

하지만 테스트 결과, RX 7600 (gfx1102)에서도 정상적으로 PyTorch GPU 연산이 동작했다.

목표

최종적으로 아래 코드가 정상적으로 실행되는 것이 목표다.

python -c "import torch; print(torch.cuda.is_available()); print(torch.cuda.get_device_name(0))"

정상 출력 예:

True

AMD Radeon RX 7600

전체 설치 구조

Windows에서 ROCm PyTorch 환경을 구축할 때의 전체 구조는 다음과 같다.

ROCm Runtime

↓

ROCm Python SDK

↓

PyTorch ROCm wheel

↓

ML / AI 라이브러리 (Whisper 등)

설치 순서: ROCm Runtime → ROCm Python SDK → PyTorch

0. ROCm Runtime 설치 (사전 준비)

PyTorch를 설치하기 전에 먼저 ROCm Runtime을 설치해야 합니다.

- AMD ROCm 다운로드 페이지 방문

- ROCm 7.2 Windows Installer 다운로드 및 실행

- 설치 완료 후 시스템 재부팅

1. ROCm GPU 인식 확인

ROCm 설치 후 GPU가 정상적으로 인식되는지 확인한다.

hipinfo

출력 예:

Name: AMD Radeon RX 7600

gcnArchName: gfx1102

GPU 정보가 표시되면 정상이다.

참고: Windows ROCm에서는

rocminfo대신hipinfo를 사용하는 경우가 많다.

2. Python 버전 확인 (매우 중요!)

PyTorch ROCm wheel은 Python 버전에 맞게 빌드되어 있다.

예를 들어 wheel 파일 이름이 다음과 같다면:

torch-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

여기서 cp312 = Python 3.12

즉, Python 3.12 환경에서만 설치 가능하다.

Python 버전 확인:

python --version

예:

Python 3.12.8

⚠️ 주의: Python 3.13 등 다른 버전이면 wheel 설치가 실패합니다.

3. 가상환경 (venv) 생성

프로젝트 폴더 생성:

mkdir C:\Dev\ml

cd C:\Dev\ml

venv 생성:

python -m venv venv

venv 활성화:

CMD:

venv\Scripts\activate

PowerShell:

.\venv\Scripts\Activate.ps1

4. ROCm Python SDK 설치

PyTorch ROCm wheel은 ROCm Python SDK 의존성이 있다.

PowerShell에서 다음 명령어로 설치한다.

pip install --no-cache-dir `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/rocm_sdk_core-7.2.0.dev0-py3-none-win_amd64.whl `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/rocm_sdk_devel-7.2.0.dev0-py3-none-win_amd64.whl `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/rocm_sdk_libraries_custom-7.2.0.dev0-py3-none-win_amd64.whl `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/rocm-7.2.0.dev0.tar.gz

참고: CMD에서는 한 줄로 실행해야 한다.

5. PyTorch ROCm Wheel 설치

PyTorch ROCm wheel을 설치하는 방법은 두 가지가 있다.

방법 1: URL로 직접 설치 (권장)

AMD 공식 리포지토리에서 직접 설치하는 방법이다.

CMD Prompt:

pip install --no-cache-dir ^

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/torch-2.9.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl ^

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/torchaudio-2.9.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl ^

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/torchvision-0.24.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl

PowerShell:

pip install --no-cache-dir `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/torch-2.9.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/torchaudio-2.9.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl `

https://repo.radeon.com/rocm/windows/rocm-rel-7.2/torchvision-0.24.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl

참고: 설치에 몇 분 정도 소요될 수 있습니다.

방법 2: Wheel 파일 다운로드 후 로컬 설치

네트워크가 불안정하거나 오프라인 설치가 필요한 경우 사용한다.

1. Wheel 파일 다운로드

브라우저 또는 PowerShell에서 다음 파일들을 다운로드한다:

# PowerShell에서 다운로드

$baseUrl = "https://repo.radeon.com/rocm/windows/rocm-rel-7.2"

Invoke-WebRequest -Uri "$baseUrl/torch-2.9.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl" `

-OutFile "torch-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl"

Invoke-WebRequest -Uri "$baseUrl/torchaudio-2.9.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl" `

-OutFile "torchaudio-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl"

Invoke-WebRequest -Uri "$baseUrl/torchvision-0.24.1%2Brocmsdk20260116-cp312-cp312-win_amd64.whl" `

-OutFile "torchvision-0.24.1+rocmsdk20260116-cp312-cp312-win_amd64.whl"

또는 직접 브라우저에서 다운로드:

- torch-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

- torchaudio-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

- torchvision-0.24.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

2. 다운로드한 Wheel 파일 설치

다운로드한 파일이 있는 디렉토리에서 실행:

pip install torch-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

pip install torchaudio-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

pip install torchvision-0.24.1+rocmsdk20260116-cp312-cp312-win_amd64.whl

💡 Tip: 로컬 wheel 파일 설치가 네트워크 오류 발생 시 더 안정적이며, 재설치 시에도 빠르다.

공식 문서: AMD ROCm PyTorch Installation Guide

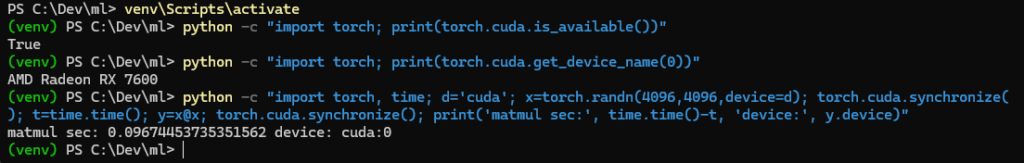

6. GPU 동작 확인

GPU 사용 여부 확인:

python -c "import torch; print(torch.cuda.is_available())"

출력 예:

True

GPU 이름 확인:

python -c "import torch; print(torch.cuda.get_device_name(0))"

출력:

AMD Radeon RX 7600

7. GPU 성능 테스트

간단한 GPU 연산 테스트:

python -c "import torch, time; d='cuda'; x=torch.randn(4096,4096,device=d); torch.cuda.synchronize(); t=time.time(); y=x@x; torch.cuda.synchronize(); print('matmul sec:', time.time()-t, 'device:', y.device)"

출력 예:

matmul sec: 0.118 device: cuda:0

GPU에서 정상적으로 연산이 수행된다.

8. Whisper GPU 테스트

GPU 기반 STT 테스트를 위해 Whisper를 설치한다.

pip install openai-whisper

테스트 코드:

import whisper

import torch

print("GPU available:", torch.cuda.is_available())

print("GPU device:", torch.cuda.get_device_name(0))

model = whisper.load_model("base", device="cuda")

result = model.transcribe("test.wav")

print(result["text"])

자주 발생하는 문제

1. ModuleNotFoundError

ModuleNotFoundError: No module named 'whisper'

원인: venv가 아닌 다른 Python으로 실행

해결:

venv\Scripts\python test.py

2. venv 이동 시 발생하는 문제

venv 폴더를 이동하면 다음 오류가 발생할 수 있다.

Fatal error in launcher

Unable to create process

원인: venv 내부 스크립트에 절대 경로가 저장되어 있음

해결: venv를 새 위치에서 다시 생성

3. Python 버전 불일치

ERROR: torch-2.9.1+rocmsdk20260116-cp312-cp312-win_amd64.whl is not a supported wheel on this platform.

원인: Python 버전이 3.12가 아님

해결: Python 3.12 설치 후 새 venv 생성

성능 참고사항

AMD ROCm은 아직 NVIDIA CUDA만큼 최적화가 완벽하지 않습니다. 하지만 다음과 같은 장점이 있습니다:

- 가성비: 같은 가격대 NVIDIA GPU 대비 더 많은 VRAM

- 오픈소스: ROCm 스택 전체가 오픈소스

- 발전 가능성: 커뮤니티와 AMD의 지속적인 개선

마무리

Windows에서도 ROCm을 사용하면 AMD GPU에서 PyTorch GPU 가속을 사용할 수 있다.

특히 다음과 같은 작업을 로컬에서 수행할 수 있다:

- 머신러닝 실험

- Whisper STT

- Stable Diffusion

- LLM inference

이제 드디어 라데온 GPU도 AI 작업에 활용할 수 있는 환경이 Windows 에서 AMD GPU 에서도 현실적으로 가능해졌다고 볼 수 있다.

물론 아직까지 자료가 적고 제약사항이 많지만, 라데온 GPU가 가진 가성비와 대용량 VRAM을 활용한 AI 환경의 가능성을 보여준 시작점이라고 생각한다.

환경 구축이 다소 까다롭지만 한 번 설정해두면 강력한 로컬 AI 개발 환경을 만들 수 있다.